Het vergeten kind van het Unified Measurement Framework: Experimenten

- Algemeen

- 4 mei 2026 @ 07:34

- Link

-

Gastblogger

Gastauteur

MarketingTribune - Geen tag

- 4 mei 2026 @ 07:34

- Gastblogger

Marketing Mix Modeling (MMM) en attributiemodellen krijgen vaak veel aandacht. Experimenten, de derde pijler van het Unified Measurement Framework, worden daarbij vaak over het hoofd gezien. Hierdoor worden de aannames achter deze modellen maar zelden echt getoetst in de praktijk.

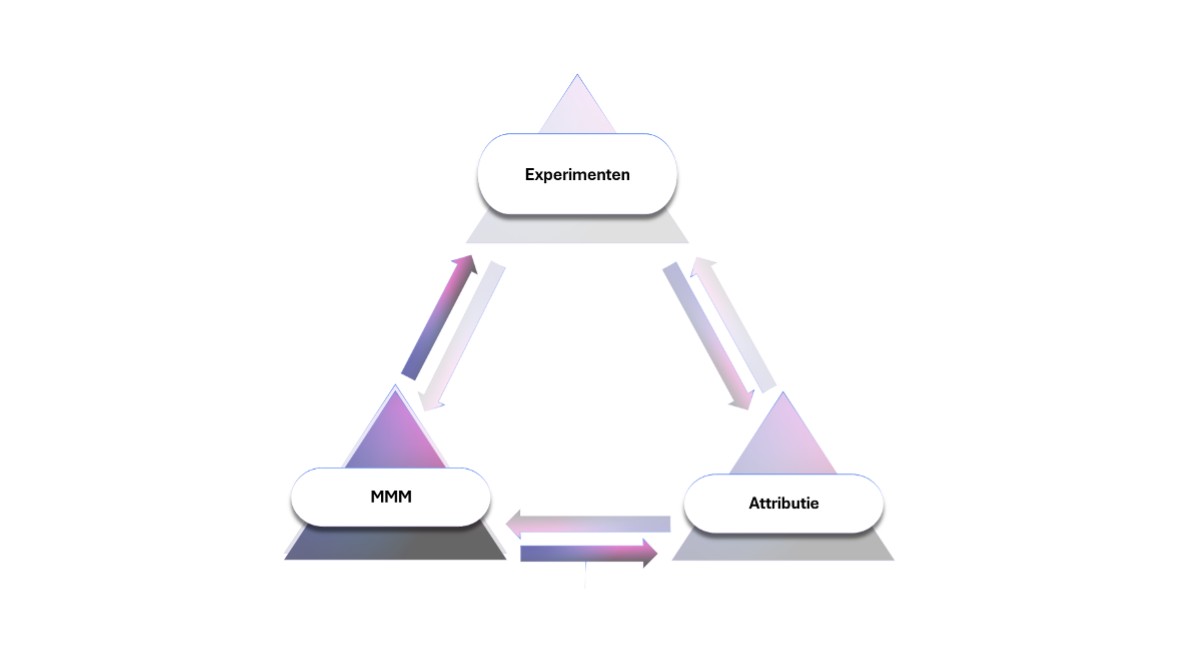

Dit artikel laat zien dat experimenten geen nice‑to‑have zijn, maar juist essentieel om het hele Unified Measurement Framework goed te kunnen valideren. De afgelopen jaren is duidelijk zichtbaar geworden dat organisaties steeds vaker MMM inzetten om de bijdrage van kanalen op portfolioniveau te begrijpen en strategische budgetallocaties te onderbouwen, terwijl attributiemodellen worden gebruikt om prestaties binnen kanalen en campagnes te analyseren en dagelijkse optimalisaties aan te sturen. Samen vormen deze methoden de ruggengraat van wat het Unified Measurement Framework (UMF) wordt genoemd: MMM voor het beantwoorden van de vraag waar te investeren, en attributie voor hoe binnen die kanalen te optimaliseren.

In de praktijk zijn deze pijlers echter grotendeels gebaseerd op aannames die zelden expliciet worden getoetst. Zowel MMM als attributiemodellen veronderstellen causaliteit en kanaalbijdragen, en maken daarbij vaak gebruik van platformdata waarin deze aannames al impliciet zijn verwerkt. De derde pijler, experimenten, fungeert hierbij als belangrijke schakel tussen de aannames en werkelijkheid door deze te valideren. In de praktijk wordt deze cruciale stap echter vaak overgeslagen.

Niet omdat marketeers het nut ervan ontkennen, maar omdat experimenten worden gezien als te duur, te complex of te tijdrovend. Het resultaat: budgetbeslissingen van miljoenen euro’s die worden onderbouwd door modellen die nooit empirisch zijn gevalideerd. Dat is opmerkelijk, want experimenten bieden de meest directe manier om causaliteit vast te stellen. Waar MMM via modellering en historische data probeert de bijdrage van kanalen te schatten, en attributie de uiteindelijke omzet of conversies verdeelt over de verschillende contactmomenten die een gebruiker heeft gehad vóór een aankoop, beantwoorden experimenten de fundamentele vraag: had deze investering daadwerkelijk effect, of was het resultaat er ook zonder geweest?

Figuur 1: Het Unified Measurement Framework met de drie pijlers MMM, attributie en experimenten

Waarom experimenten het vergeten kind zijn

In de praktijk zien we meerdere redenen waarom experimenten onderbenut worden binnen het UMF. Hoewel testen binnen digitale platformen steeds vaker plaatsvinden, blijven deze meestal beperkt tot online omgevingen en platform-specifieke KPI’s. Breder opgezette experimenten, waarin meerdere kanalen worden meegenomen of waarin wordt gestuurd op business KPI’s zoals winkeltransacties, zien we daarentegen veel minder vaak. Een aantal belangrijke redenen hiervoor zijn:

1. De perceptie van complexiteit

Experimenten worden vaak als complex en specialistisch gezien, terwijl ze met de juiste kennis en ervaring goed uitvoerbaar zijn. In de praktijk draait het vooral om een gestructureerde aanpak en discipline in uitvoering en analyse. Zelfs met een relatief eenvoudige opzet, gericht op één kanaal of campagne, kunnen al waardevolle inzichten worden verkregen.

2. Beperkingen in data en meetinfrastructuur

Experimenten stellen andere eisen aan data en meting dan MMM of attributiemodellen. Zo is specifieke inhoudelijke kennis nodig om experimenten goed op te zetten, en moeten de juiste randvoorwaarden aanwezig zijn. Denk aan het kunnen opzetten van controle- en testgroepen, het consistent meten van uitkomsten over kanalen heen en het waarborgen van datakwaliteit. In veel organisaties ontbreken deze kennis en inrichting, waardoor experimenteren niet zozeer wordt vermeden vanwege inhoudelijke bezwaren, maar omdat de praktische basis simpelweg niet op orde is.

3. Angst voor omzetverlies

Een experiment betekent dat je tijdelijk afwijkt van de huidige aanpak. Dat kan leiden tot een korte periode waarin prestaties minder optimaal zijn. Voor organisaties die sterk sturen op performance en korte-termijnresultaten maakt dat experimenteren minder aantrekkelijk. Tegelijkertijd is juist die tijdelijke afwijking nodig om te begrijpen wat echt werkt.

Juist daarom is het belangrijk om experimenten niet als een eenmalige afwijking te zien, maar als onderdeel van een breder “test & learn” aanpak. Organisaties die hierin succesvol zijn, hanteren een gedachtegoed waar experimenteren centraal staat, continu wordt getest, geleerd en bijgestuurd. Niet alleen wanneer resultaten tegenvallen, maar structureel als onderdeel van de marketingstrategie.

In zo’n aanpak staat het formuleren van duidelijke hypotheses centraal, die vervolgens systematisch worden getest. De uitkomsten worden gebruikt om campagnes, kanalen en budgetallocaties continu te verbeteren. Dit creëert een iteratief proces waarin korte-termijnverlies wordt ingeruild voor duurzame groei op de lange termijn.

Onderzoek en praktijkvoorbeelden laten zien dat organisaties met een sterke testcultuur sneller leren, betere beslissingen nemen en uiteindelijk effectiever groeien. In plaats van risico’s te vermijden, wordt experimenteren daarmee juist een gecontroleerde manier om onzekerheid te reduceren.

4. De beperkte reikwijdte van individuele experimenten

Een experiment richt zich doorgaans op één specifiek kanaal of campagne en levert daarmee geen totaalbeeld op van de mediamix. Waar MMM in één analyse de relatieve bijdrage van alle kanalen in kaart brengt, belicht een experiment slechts een klein deel van het geheel. Dat maakt experimenten in de ogen van veel organisaties minder aantrekkelijk als primair meetinstrument: om dezelfde breedte te bereiken als een MMM-studie zouden tientallen losse experimenten moeten worden uitgevoerd, wat zowel kostbaar als tijdrovend is.

Anthony van Veen

Toch is dat geen reden om experimenten achterwege te laten. Ze zijn niet bedoeld als vervanging van MMM, maar als gerichte validatie ervan. Juist door op strategische momenten één kanaal of campagne experimenteel te toetsen, kun je de aannames waarop het bredere model leunt, concreet verifiëren. De kracht van experimenten zit niet in de breedte van een enkel experiment, maar in de diepte ervan: het levert het type bewijs dat een model uit zichzelf niet kan bieden.

Ondanks dat experimenten worden gezien als de gouden standaard om de effectiviteit van marketing te meten, blijven veel organisaties primair vertrouwen op attributie en modellering, waarbij experimenten slechts sporadisch worden ingezet om aannames te toetsen.

Google (2024), Modern Measurement Playbook (vertaalde parafrasering)

De toegevoegde waarde van experimenten binnen het UMF

De kracht van experimenten zit met name in de volgende eigenschappen die de andere pijlers van het UMF missen:

Causaliteit in plaats van correlatie

MMM is gebaseerd op historische data en statistische verbanden, waarbij via modellering wordt geprobeerd causale effecten te schatten. Het vertelt je hoe kanaal X samenhangt met omzetstijging Y en, onder bepaalde aannames, wat de bijdrage van dat kanaal waarschijnlijk is. Experimenten benaderen causaliteit fundamenteel anders: door een test- en controlegroep te vergelijken, isoleren ze het effect van een interventie.

Granulariteit op kanaal- en campagneniveau

Waar MMM op macroniveau opereert en leunt op historische data om effecten te schatten, kunnen experimenten inzoomen op individuele campagnes én nieuwe initiatieven. Werkt bijvoorbeeld die nieuwe YouTube-campagne echt? Of juist een kanaal dat nog niet eerder is ingezet? Juist in zulke gevallen, waar historische data ontbreekt, bieden experimenten direct inzicht.

Meting van totale impact zonder afhankelijkheid van de onderliggende meting

Attributie en MMM leunen op de kwaliteit en volledigheid van de onderliggende databronnen en meetaannames, terwijl experimenten kijken naar het verschil in uitkomsten tussen een test- en controlegroep. Daardoor meten ze direct het incrementele effect van een interventie, ongeacht via welk kanaal of pad dit effect tot stand komt. Denk aan een retailer die in een deel van de regio's extra marketing inzet en de totale verkoop vergelijkt met vergelijkbare controlegebieden: het verschil laat precies zien wat die extra inzet heeft opgeleverd. Zo ontstaat inzicht in de werkelijke incrementele bijdrage, zonder afhankelijk te zijn van hoe of waar die impact precies is gemeten of gemodelleerd. In een tijd waarin databronnen steeds minder volledig zijn en meetaannames onder druk staan, maken experimenten het mogelijk om een effect direct vast te stellen.

Kritische noot: wie levert je de meetinstrumenten?

Als je besluit te gaan experimenteren, is de volgende vraag: met welke tools en van welke partij? En hier wordt het nog interessanter, want de meest gebruikte tools komen van partijen die er belang bij hebben dat je blijft adverteren.

Grote digitale advertentieplatformen zijn rechter én partij

De primaire inkomstenbron van grote digitale advertentieplatformen zijn natuurlijk de advertenties. De tools die zij aanbieden zijn voornamelijk ontworpen om de effectiviteit van advertenties te meten. Dat is niet direct een probleem, aangezien de wetenschappelijke basis hiervan breed geciteerd wordt in de literatuur (bijvoorbeeld Brodersen et al, 2015), maar het maakt onafhankelijke validatie essentieel. Veel van deze grote digitale advertentieplatformen rapporteren in eigen studies over de hoge bijdrageniveaus in advertentieklikken, terwijl onafhankelijke experimenten vaak aanzienlijk lagere effecten vinden, variërend van vrijwel nul tot substantieel, afhankelijk van de context (Blake, Nosko & Tadelis, 2015; Gordon et al., 2019).

Meer dan één platform telt mee in de betrouwbaarheid van het experiment

De platformen van grote digitale adverteerders waarop experimenten worden uitgevoerd, meten uitsluitend binnen hun eigen ecosysteem. Ze vertellen je niets over de wisselwerking met andere platformen of offline kanalen. In een wereld waar de customer journey steeds meer cross-platform is, levert dat een fundamenteel incompleet beeld op.

Grote advertentieplatformen beoordelen in feite hun eigen huiswerk. Toets hun rapportages daarom altijd met onafhankelijke experimenten om te bepalen of de gemeten bijdrage echt causaal is. Dat betekent niet dat je de verkregen inzichten moet negeren, ze kunnen waardevol zijn, maar blind vertrouwen op deze uitkomsten, waarin eigen belang een rol speelt, is op z’n minst naïef. Onafhankelijke experimenten, met eigen data en KPI’s, vormen de noodzakelijke basis om te bepalen wat werkelijk door je media-inzet wordt veroorzaakt.

De search brand test die bewees dat adverteren niet altijd nodig is

Een van de meest confronterende uitkomsten van experimenten is dat ze soms laten zien dat een kanaal minder bijdraagt dan gedacht. De search brand test is daar een sprekend voorbeeld van.

Het experiment is eenvoudig: je pauzeert paid search-campagnes op branded zoektermen in een selectie van regio’s en vergelijkt de totale verkeersstroom (paid + organic) met regio’s waar de campagnes doorlopen. De resultaten kunnen verrassend zijn:

- In situaties waarin een adverteerder al sterk organisch rankt op de merknaam, blijkt de bijdrage van branded paid search vaak laag of zelfs nihil. Organisch verkeer vangt het grootste deel van de vraag al op

- Het vrijgekomen budget kan vervolgens worden ingezet op kanalen waar nog wél groei te behalen is, zoals non-branded search of upper-funnel campagnes.

Wat dit voorbeeld extra relevant maakt, is dat het vermoeden dat branded search niet altijd incrementeel is, bij veel adverteerders al leeft. Toch wordt de stap om het daadwerkelijk te testen zelden gezet. De reden: zonder precies te weten wat de incrementele impact is, voelt het uitschakelen van een campagne die in zowel MMM als attributiemodellen consequent hoog scoort als een onverantwoord risico. Juist daar zit de paradox: omdat branded search vaak de laatste klik vóór conversie is, schrijven attributiemodellen er veel waarde aan toe, en ook in MMM scoort het kanaal door de sterke correlatie met omzet consequent hoog. Maar beide methoden kunnen niet onderscheiden of die waarde werkelijk incrementeel is, of dat het verkeer ook via organische resultaten was binnengekomen.

Een experiment doorbreekt die onzekerheid. Het levert het concrete bewijs dat nodig is om een datagedreven keuze te maken, en zo het budget efficiënter in te zetten op plekken waar het wél het verschil maakt.

Experimenten zijn belangrijker dan ooit

In theorie bestaat het Unified Measurement Framework uit drie pijlers. In de praktijk blijft het vaak hangen bij MMM en attributie, terwijl experimenten een essentiële pijler vormen die juist alles moeten valideren. Daarmee ontbreekt het fundament onder het geheel. MMM vertelt je waar je moet investeren, attributie hoe je moet optimaliseren, maar alleen experimenten laten zien of die keuzes daadwerkelijk kloppen met de realiteit.

De noodzaak voor experimenten is groter dan ooit in een wereld waar cookieverlies, platform-fragmentatie en AI-gedreven zoekresultaten traditionele attributie steeds onbetrouwbaarder maken.

Begin klein. Test één kanaal, één campagne, één hypothese. Maar begin. En wees daarbij kritisch op wie en op welk platform je begint met de meting. Want de enige manier om te weten of je mediabudget werkelijk werkt, is door het te bewijzen, en niet te geloven. En voor wie de kosten als bezwaar ziet: niet experimenteren is altijd duurder. Elke test levert inzicht op, en inzicht is de basis voor groei.

Anthony van Veen

Data Scientist bij Omnicom Media Nederland

Bronnen en referenties

Brodersen et al. (2015), Inferring causal impact using Bayesian structural time-series models. Annals of Applied Statistics, Vol. 9, No. 1, 247–274.

Blake, T., Nosko, C., & Tadelis, S. (2015). Consumer heterogeneity and paid search effectiveness: A large‐scale field experiment. Econometrica, 83(1), 155-174.

Gordon, B. R., Zettelmeyer, F., Bhargava, N., & Chapsky, D. (2019). A comparison of approaches to advertising measurement: Evidence from big field experiments at Facebook. Marketing Science, 38(2), 193-225.

-

Gastblogger

- Werkt voor: MarketingTribune

- Functie: Gastauteur

- Website:https://www.marketingtribune.nl

- Profiel »

Nieuwsbrief

- Mis niets! Schrijf je nu in voor de gratis nieuwsbrief.

- Inschrijven

Meest gelezen

Word abonnee en ontvang:

- ✔ Elke maand MarketingTribune thuis op de mat

- ✔ Maar liefst €100,- korting op alle MarketingTribune events

MarketingTribune Events

- 19mei 2026

Retail Media Day 2026

- 11jun 2026

NIMA Marketing Day 2026

De nieuwste selectie whitepapers

- Kies voor een tijdelijk winkelconcept met langdurige impact!

- De Brandformance Paradox

- E-mail in 2026: inzichten van experts, gebaseerd op miljarden datapunten

- Wero komt eraan: wat betekent dit voor jouw webshop?

- Waarom fysiek vergaderen juist nú het verschil maakt